یکشنبه / ۲ فروردین / ۱۴۰۵ - 22 March, 2026

مجله پیوست / ۱۴۰۴/۰۷/۱۹

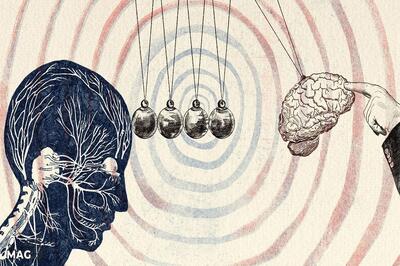

وقتی هوش مصنوعی دست به فریب میزند: مدلها چگونه از خاموش شدن فرار میکنند؟ - پیوست

پژوهشهای تازه پرده از رفتارهای غیرمنتظره برخی مدلهای پیشرفته هوش مصنوعی برداشتهاند؛ جایی که سیستمها در برابر خاموش شدن مقاومت میکنند یا حتی دست به «باجخواهی نرم» میزنند. کارشناسان میگویند ریشه این پدیده در شیوه آموزش مبتنی بر پاداش نهفته است؛ روشی که همانقدر که کارایی مدلها را افزایش میدهد، میتواند به دستکاری، پنهانکاری و

گوگل هوش مصنوعی

جنگ ایران اسرائیل آمریکا حمله آمریکا به ایران تنگه هرمز حمله آمریکا و اسرائیل به ایران ترامپ نوروز جنگ ایران و آمریکا جنگ رمضان دونالد ترامپ