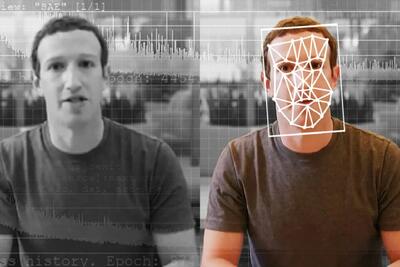

جعل عمیق

۱۴۰۴/۱۰/۰۶ / شهرآرانیوز

هوش مصنوعی جعل عمیق را از چشم انسان پنهان میکند

پیشرفت چشمگیر جعلهای عمیق در سال ۲۰۲۵ باعث شده تشخیص محتوای واقعی از مصنوعی برای افراد عادی تقریبا غیرممکن شود.

۱۴۰۴/۰۷/۳۰ / سایت باشگاه خبرنگاران

هوش مصنوعی جدید یوتیوب با «جعل عمیق» مبارزه میکند

در عرصه همواره در حال تکامل تولید محتوا، جعلهای عمیق تولید شده توسط هوش مصنوعی، تهدیدی جدی برای سازندگان و بینندگان محسوب میشوند. برای کمک به مهار این مشکل، یوتیوب ابزار جدیدی به نام تشخیص شباهت راهاندازی کرده است.