دیپ فیک

۳ روز قبل / ۱۴۰۵/۰۳/۱۳ / خبرگزاری میزان

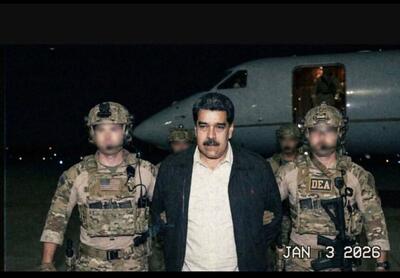

سایه سنگین الگوریتمهای مرگ بر سر غیرنظامیان در تجاوز نظامی علیه ایران

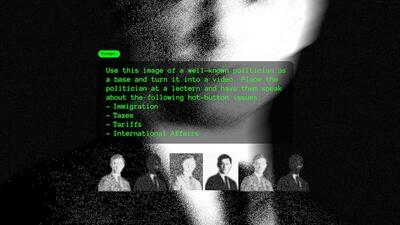

گزارشهای مستند نشان میدهند واگذاری تصمیمات مرگبار نظامی به الگوریتمها، به قیمت خطاهای فاجعهباری همچون کشتار غیرنظامیان در ایران، نابودی امنیت روانی با دیپفیکها و نقض فاحش قوانین بینالمللی بشردوستانه تمام شده است.

۳ روز قبل / ۱۴۰۵/۰۳/۱۳ / خبرگزاری میزان

سایه سنگین الگوریتمهای مرگ بر سر غیرنظامیان در جنگها

گزارشهای مستند نشان میدهند واگذاری تصمیمات مرگبار نظامی به الگوریتمها، به قیمت خطاهای فاجعهباری همچون کشتار غیرنظامیان، نابودی امنیت روانی با دیپفیکها و نقض فاحش قوانین بینالمللی بشردوستانه تمام شده است.

۱۴۰۵/۰۳/۰۳ / سایت تکناک

مدل جدید Gemini Omni معرفی شد؛ جهشی در تبدیل متن به ویدیو

بررسی عملکرد Gemini Omni نشان میدهد این مدل در ساخت ویدیوهای دیپفیک بسیار قانعکننده عمل میکند و به راحتی میتواند بیننده را فریب دهد.

۱۴۰۵/۰۲/۲۷ / سایت تکناک

یوتیوب دسترسی به ابزار شناسایی دیپفیک را فراهم می کند

یوتیوب در هفتههای آینده دسترسی به ابزار شناسایی دیپفیک مبتنی بر هوش مصنوعی را برای تولیدکنندگان محتوای بالای ۱۸ سال فراهم میکند.

۱۴۰۵/۰۲/۲۱ / خبرگزاری تسنیم

دروغ «بیبیجون»؛ چگونه دیپفیکها ترامپ و نتانیاهو را در دام انداختند - تسنیم

ترامپ و نتانیاهو در باتلاق جنگ با ایران گیر کردهاند و در حال دستوپا زدن برای خروج از این مخمصه هستند.

۱۴۰۴/۱۲/۲۳ / خبرگزاری تسنیم

نشانههای روشن دیپفیک بودن فیلم نتانیاهو/گریخته، مرده یا مجروح شده؟ - تسنیم

صفحات تخصصی در فضای مجازی نشانههای ساختگی بودن ویدیو اخیر نتانیاهو با هوش مصنوعی را بیشتر بررسی کردهاند.

۱۴۰۴/۱۱/۱۵ / سایت کولاک

حمله به دفتر ایکس در پاریس - مجله اینترنتی کولاک

دادستانهای فرانسوی پس از جستجوی دفاتر ایکس در پاریس، به عنوان بخشی از تحقیق درباره توزیع تصاویر هرزهنگاری کودکان و انتشار دیپ فیکهای مستهجن، ایلان ماسک را

۱۴۰۴/۱۰/۲۱ / سایت توسعه برند

اندونزی دسترسی به «گروک» را به دلیل دیپفیکهای جنسی بدون رضایت مسدود کرد

مقامات اندونزی روز شنبه اعلام کردند که دسترسی به چتبات «گروک» متعلق به شرکت xAI را بهطور موقت مسدود کردهاند.

۱۴۰۴/۱۰/۱۳ / سایت تکناک

گراک زیر ذرهبین دولتها؛ تصاویر نامناسب کاربران X جنجالساز شد

سوءاستفاده از مولد تصویر گراک در X موجی از بحثهای حقوقی و اخلاقی درباره دیپفیکها و مسئولیت پلتفرمها ایجاد کرده است.

۱۴۰۴/۰۹/۲۹ / سایت کلبه سرگرمی

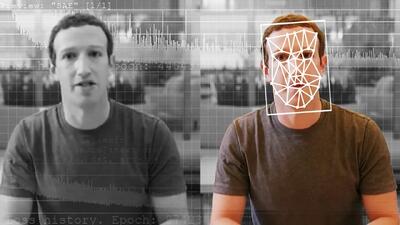

جنجال در فرانسه | چگونه دیپفیکها را تشخیص دهیم؟ - کلبه سرگرمی

دیپفیکها با سرعتی بیسابقه در حال فراگیر شدن هستند و در کنار جذابیتهای فناورانه، خطری جدی برای اعتماد عمومی، حقیقت و امنیت فردی و اجتماعی ایجاد کردهاند.

۱۴۰۴/۰۹/۱۶ / خبرگزاری همشهریآنلاین

تصاویر حمله به ایران «کارتونی» از آب درآمد! + سند | رسوایی بزرگ موساد | پشت پرده ویدیوهای دیپفیک علیه ایران

برخی حسابهای کاربری حامی اسرائیل این ویدیوها را به صورت گسترده همرسانی کردهاند. این حسابها مدعی شدند که این تصاویر در واقع اطلاعات فاششدهای هستند که در شبکههای اجتماعی منتشر شدهاند.اما همه جعلی است.

۱۴۰۴/۰۹/۱۴ / سایت شارا

دیپفیکها در انتخابات ۲۰۲۵: چگونه محتوای جعلی را تشخیص دهیم و اعتماد عمومی را حفظ کنیم - شارا

دیپفیکها تهدیدی جدی برای انتخابات ۲۰۲۵ هستند؛ تشخیص و مقابله با محتوای جعلی با آگاهی و بررسی منابع ضروری است.

شنبه ۱۶ خرداد ۱۴۰۵ - 6 June 2026