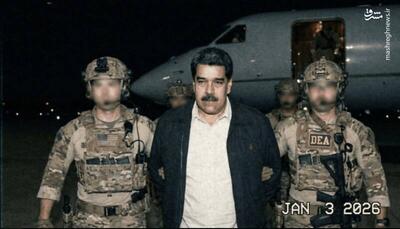

تصاویر جعلی

۱۴۰۴/۱۲/۱۶ / شهرآرانیوز

جعل تصاویر انفجار ناشی از حملات آمریکایی-صهیونی به ایران با هوش مصنوعی

ویدیوهای جعلی ساخته شده در مورد جنگ ایران که با هوش مصنوعی ساخته شدهاند؛ در این روزها افزایش یافته است و حتی برخی از این راه درآمد کسب میکنند.

۱۴۰۴/۱۲/۰۴ / سایت کولاک

واکنش به تصاویر حضور یگان ویژه در دانشگاهها - مجله اینترنتی کولاک

دفتر سخنگوی فراجا حضور یگان ویژه و امداد در دانشگاهها را شایعه جعلی و تصاویر منتشر شده را ساختگی خواند.

۱۴۰۴/۱۰/۲۱ / خبرگزاری تسنیم

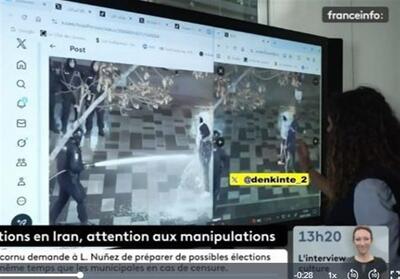

توسل رژیم صهیونیستی به هوش مصنوعی برای جعل اخبار ایران - تسنیم

شبکه فرانس انفو از انتشار تصاویر جعلی از اغتشاشات ایران از سوی رژیم صهیونیستی خبر داد.

۱۴۰۴/۱۰/۱۴ / خبرگزاری مهر

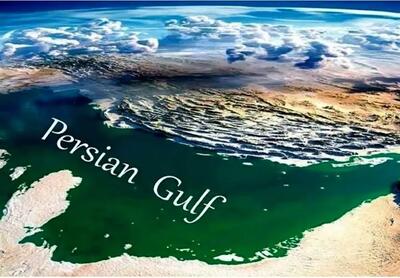

جا زدن تصاویر یونان جای ایران!

در گیجگاه این قسمت، اخبار جعلی چند روز گذشته فضای مجازی را نگاهی میکنیم.

۱۴۰۴/۱۰/۱۴ / سایت کلبه سرگرمی

موج انتقاد جهانی از «گروک» | هوش مصنوعی ایلان ماسک متهم به انتشار تصاویر غیراخلاقی در شبکه X شد - کلبه سرگرمی

هوش مصنوعی «گروک» با اتهام تولید و انتشار تصاویر غیراخلاقی جعلی از کاربران در پلتفرم ایکس مواجه شد.

۱۴۰۴/۱۰/۱۲ / سایت کلبه سرگرمی

پلیس: تصاویر جعلی مأموران با هوش مصنوعی را بازنشر نکنید - کلبه سرگرمی

رئیس پلیس فتا فراجا نسبت به افزایش تولید و انتشار تصاویر و ویدئوهای جعلی مبتنی بر هوش مصنوعی با انتساب دروغین به فرماندهان، مدیران و مأموران نظامی و انتظامی