فریب در هوش مصنوعی

۱۴۰۳/۱۰/۲۹ / سایت انتخاب

کلاهبرداری با هوش مصنوعی: زن فرانسوی ۷۰۰ هزار پوند برای درمان سرطان «برد پیت» پرداخت کرد

زنی که فریب کلاهبردار آنلاین را خورد و ۷۰۰,۰۰۰ پوند از دست داد، اکنون با افسردگی شدید، بیخانمانی و وضعیت مالی بد روبهروست.

۱۴۰۳/۱۰/۲۸ / سایت اطلاعات آنلاین

کلاهبرداری سنگین با نام بازیگر مشهور؛ وقتی هوش مصنوعی خطرناک میشود! +عکس

برد پیت به تازگی به کلاهبرداری ۸۰۰ هزار یورویی از یک زن فرانسوی که فریب هویت جعلی او را خورده بود، واکنش نشان داد و این اقدام را «وحشتناک» خواند.

۱۴۰۳/۱۰/۰۹ / سایت دنده ۶

«چتجیپیتی سرچ» در خطر فریب خوردن است

روزنامه بریتانیایی «گاردین» نوشت موتور جستوجوی «چتجیپیتی سرچ»(ChatGPT Search) مبتنی بر هوش مصنوعی که در ماه جاری میلادی راهاندازی شد

۱۴۰۳/۰۶/۳۱ / سایت دنده ۶

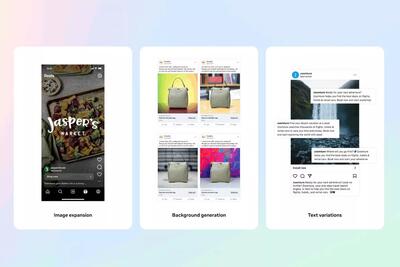

چگونه فریب عکس و فیلمهای تولیدشده توسط هوش مصنوعی را نخوریم؟

از همین رو بسیار مهم است که اطلاعات نادرست تولیدشده توسط هوش مصنوعی را بررسی کنید که سؤالات بیشتری بپرسید

۱۴۰۳/۰۶/۲۹ / خبرگزاری ایسنا

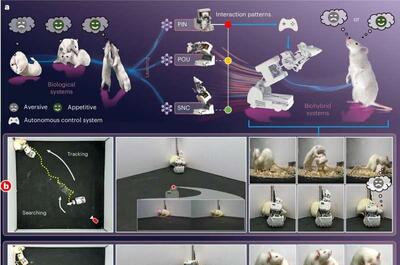

مدل جدید هوش مصنوعی مخاطب را فریب میدهد/راهکاری تازه برای شنیدن افرادی که قادر به صحبت کردن نیستند

سرویس علم و فناوری ایسنا در روز پنجشنبه میزبان اخبار گوناگونی در حوزههای فضا، هوش مصنوعی، دانشبنیان، علم و فناوری بود.

۱۴۰۳/۰۲/۲۶ / سایت دنده ۶

هوش مصنوعی یاد گرفته چطور انسانها را فریب دهد!

در حالی که پارک و همکارانش فکر میکنند جامعه علمی هنوز اقدام مناسبی برای رسیدگی به فریب هوش مصنوعی انجام نداده است

۱۴۰۳/۰۲/۲۵ / سایت جهان صنعت نیوز

هوش مصنوعی انسان را فریب می دهد

محققان در پژوهش خود مدل GPT-4 و CICERO متا را مورد بررسی قرار دادند.

۱۴۰۳/۰۲/۲۴ / سایت اقتصاد ایران

هوش مصنوعی فریبکار!

فریب انسان محققان در پژوهش خود مدل GPT-4 و CICERO متا را مورد بررسی قرار دادند. محققان در پژوهش خود متا را مورد بررسی قرار دادند.

پنجشنبه ۲۵ بهمن ۱۴۰۳ - 13 February 2025

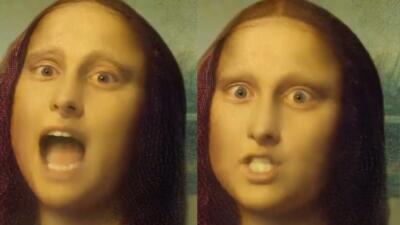

![واقعیت یا فریب؟ پیشرفتهترین دیپفیک جهان شما را حیرتزده میکند! [تماشا کنید]](/news/u/2025-02-06/shahrsakhtafzar-81ljn.jpg)

![ویدیوی نجات خرس قطبی که با هوش مصنوعی ساخته شده، کاربران را فریب داد [تماشا کنید]](/news/u/2024-11-20/digiato-mz78f.jpg)