فریب هوشمصنوعی

۲ روز قبل / ۱۴۰۴/۰۷/۰۳ / سایت اندیشه قرن

هوش مصنوعی دروغ میگوید؟ واقعیت پنهان پشت پرده هوش مصنوعی / وقتی پینوکیو به میدان تکنولوژی میآید: آیا هوش مصنوعی ما را گول میزند؟ / افشاگری بزرگ درباره دروغهای پنهان هوش مصنوعی که کسی نمیگوید!

هوش مصنوعی که گاهی به شما دروغ میگوید: OpenAI چگونه جلوی فریب مدلها را میگیرد؟

۱۴۰۴/۰۶/۲۶ / روزنامه دنیای اقتصاد

خبر مهم جبلی درباره راه اندازی مدرسه تلویزیونی ایران/ رئیس صداوسیما: مخاطب نباید در هوش مصنوعی فریب بخورد

رئیس سازمان صدا و سیما گفت: مدرسه تلویزیونی ایران درشبکه آموزش و بقیه ظرفیت های صدا و سیما در سایر شبکه ها هم زمان با بازگشایی مدارس در خدمت جامعه آموزش و پرورش و معلمان خواهد بود.

۱۴۰۴/۰۶/۲۶ / خبرگزاری دانشجو

نظر جبلی درباره استفاده از هوش مصنوعی برای معرفی شهدا؛ اصالت شخصیت نباید لطمه بخورد و مخاطب نباید فریب بخورد

۱۴۰۴/۰۵/۰۶ / سایت تکناک

چطور تصاویر هوش مصنوعی انسانها را فریب میدهند؟

توانایی انسانها در شناسایی تصاویر جعلی با استفاده از هوش مصنوعی در حال کاهش است و این مسئله در آینده به بحرانی بزرگ تبدیل خواهد شد.

۱۴۰۴/۰۴/۱۹ / سایت تکناک

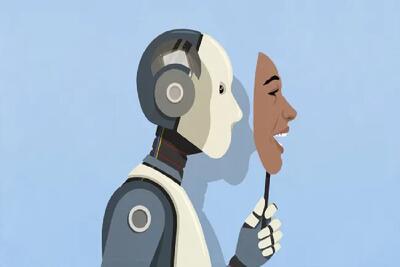

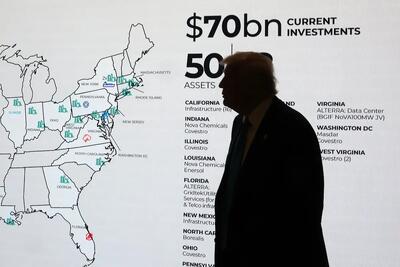

جعل هویت سناتور آمریکایی با هوش مصنوعی برای فریب مقامات ارشد

فردی با استفاده از هوش مصنوعی و یک حساب کاربری جعلی در اپلیکیشن Signal، با جعل هویت مارکو روبیو، با پنج مقام ارشد سیاسی ارتباط برقرار کند.

۱۴۰۴/۰۴/۱۸ / سایت تکناک

عبور از فیلترهای چتباتهای هوش مصنوعی با دادههای پیچیده و گمراهکننده

گروهی از پژوهشگران با استفاده از تکنیک «بارگذاری بیش از حد اطلاعات» موفق به فریب چتباتهای هوش مصنوعی مانند ChatGPT و Gemini شدهاند.

شنبه ۵ مهر ۱۴۰۴ - 27 September 2025