ویدیوهای جعلی

۱۴۰۴/۱۲/۱۶ / شهرآرانیوز

جعل تصاویر انفجار ناشی از حملات آمریکایی-صهیونی به ایران با هوش مصنوعی

ویدیوهای جعلی ساخته شده در مورد جنگ ایران که با هوش مصنوعی ساخته شدهاند؛ در این روزها افزایش یافته است و حتی برخی از این راه درآمد کسب میکنند.

۱۴۰۴/۰۹/۱۶ / خبرگزاری همشهریآنلاین

تصاویر حمله به ایران «کارتونی» از آب درآمد! + سند | رسوایی بزرگ موساد | پشت پرده ویدیوهای دیپفیک علیه ایران

برخی حسابهای کاربری حامی اسرائیل این ویدیوها را به صورت گسترده همرسانی کردهاند. این حسابها مدعی شدند که این تصاویر در واقع اطلاعات فاششدهای هستند که در شبکههای اجتماعی منتشر شدهاند.اما همه جعلی است.

۱۴۰۴/۰۷/۱۷ / سایت سلام سینما

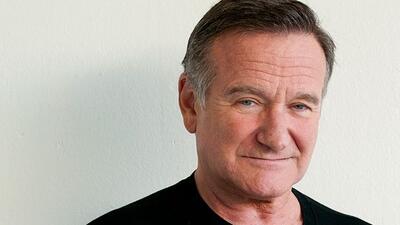

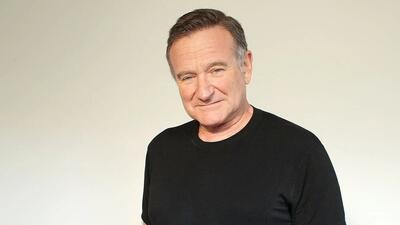

واکنش دختر رابین ویلیامز به ویدیوهای جعلی

زلدا ویلیامز، دختر بازیگر و کمدین فقید رابین ویلیامز، از کاربران خواست تا ساخت و ارسال ویدیوهای تولیدشده با هوش مصنوعی از پدرش را متوقف کنند.